La competencia entre Google y OpenAI por dominar la inteligencia artificial es intensa. En los últimos meses, ambas compañías han estado definiendo sus estrategias para lograrlo. Mientras que OpenAI, dirigido por Sam Altman, ha adoptado un enfoque más cerrado limitando el acceso de los investigadores a sus últimas tecnologías, Google aún mantiene dinámicas del pasado en el hogar de Sundar Pichai.

El gigante de la búsqueda anunció recientemente una familia de modelos de lenguaje de gran tamaño que se presentan como «abiertos». La firma asegura que esta alternativa se basa en los avances obtenidos para crear Gemini y es el resultado del trabajo de los laboratorios de DeepMind, así como de otros equipos especializados dentro de Google. A continuación, algunos detalles más sobre Gemma.

Gemma, disponible a partir de hoy en todo el mundo

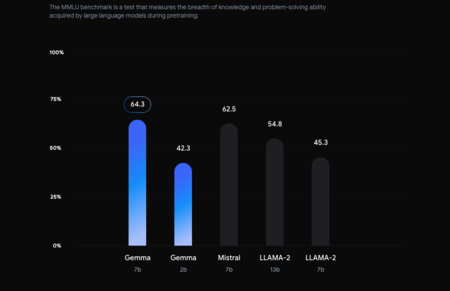

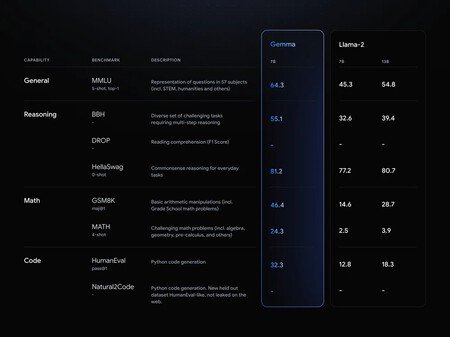

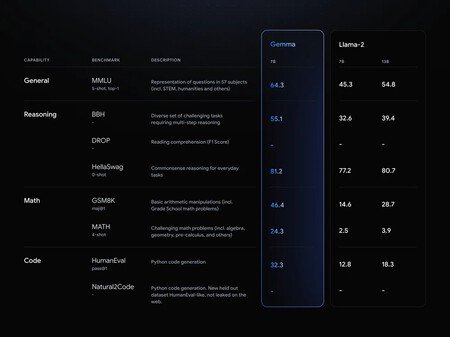

Cuando Google habla de una familia de modelos, en esta etapa inicial se refiere a dos modelos: 2B y Gemma 7B. Estas dos variantes, una más pequeña y otra mucho más grande en términos de parámetros de entrenamiento, «establecen un nuevo estándar de rendimiento» frente a competidores como Llama 2 de Meta y Mistral 7B, según Google. No obstante, habrá que comprobar si esta promesa se cumple más allá del papel.

El rendimiento de Gemma, según documentos publicados por Google (y en la imagen), ha sido evaluado a través de numerosos benchmarks. En particular, en MMLU, un benchmark diseñado para medir la amplitud de conocimiento y la capacidad de resolución de problemas del modelo, Gema 7B supera ligeramente a Mistral 7B, Llama 2 13B y Llama 2 7B. Por otro lado, Gema 2B se sitúa por debajo en todos los escenarios.

Un aspecto clave del enfoque abierto de los modelos Gemma es que los desarrolladores tienen mayor versatilidad para experimentar con ellos, aunque es importante mencionar que no se trata de una solución completamente abierta. Los modelos siguen teniendo algunas restricciones de uso establecidas por Google en los términos de licencia. Aun así, el hecho de que estén disponibles para el público es una buena noticia para el desarrollo de esta tecnología.

Según Google, los usuarios tienen la posibilidad de modificar los modelos con entrenamiento adicional para adaptarlos a necesidades específicas. Por lo tanto, ambas propuestas se distribuyen en versiones preentrenadas e instruidas. Los desarrolladores desempeñan un papel crucial en exprimir al máximo las capacidades del modelo, que puede generar texto y realizar tareas específicas para las que haya sido entrenado con las herramientas disponibles.

Por último, es posible acceder a Gemma a través de diferentes vías. Google prefiere que los interesados en utilizar esta solución lo hagan a través de su plataforma Google Cloud, que permite realizar una amplia gama de tareas directamente desde la nube y sin utilizar capacidad de cómputo local, aunque se paga por uso. También existe la opción de descargarlos a través de la plataforma Kaggle para funcionar desde un ordenador.

Imágenes: Google

En Ciberpro: El CEO de NVIDIA confiesa qué carrera cursaría y es muy mala noticia para la informática